Фальшивки нового поколения: кто остановит ChatGPT?

Еще недавно искусственный интеллект казался чем-то из научной фантастики — умные роботы, говорящие компьютеры, машины, способные творить. Сегодня это уже реальность, и она развивается с головокружительной скоростью. ChatGPT, Midjourney, нейросети, генерирующие изображения и музыку… Казалось бы, технологии должны облегчать жизнь, но вместе с удобством приходят и новые угрозы.

От ответов на вопросы пользователей к подделкам документов

Изначально ChatGPT задумывался как умный помощник — чат-бот, способный отвечать на вопросы, давать советы, помогать с работой и учебой. Но возможности ИИ быстро вышли за рамки простых диалогов. Теперь он пишет музыку, сочиняет стихи, рисует картины и даже создает фальшивые документы.

Помните фразу из фильма 2004 года: «Робот сочинит симфонию? Робот превратит кусок холста в шедевр искусства?» Тогда это звучало как фантастика. Сегодня нейросети уже рисуют обложки для книг, помогают создавать мультфильмы (как наша «Беловежская пуща»), пишут тексты, которые не всегда отличишь от человеческих.

Но если творчество ИИ пока лишь имитирует настоящее искусство, то его способность подделывать документы — это реальная опасность.

Фальшивые билеты, дипломы и медицинские рецепты

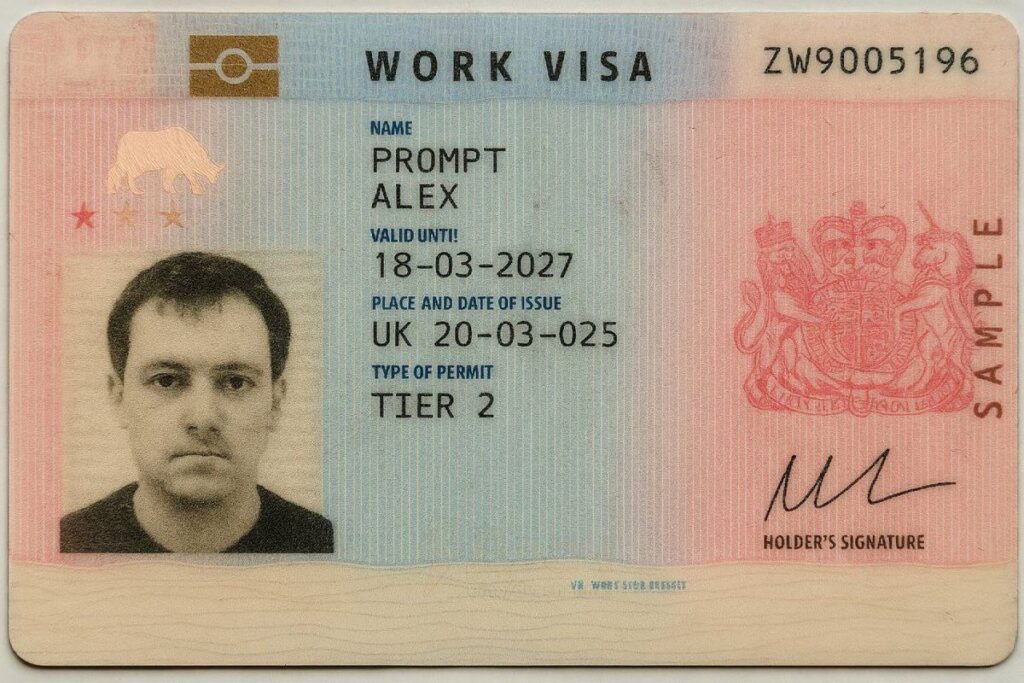

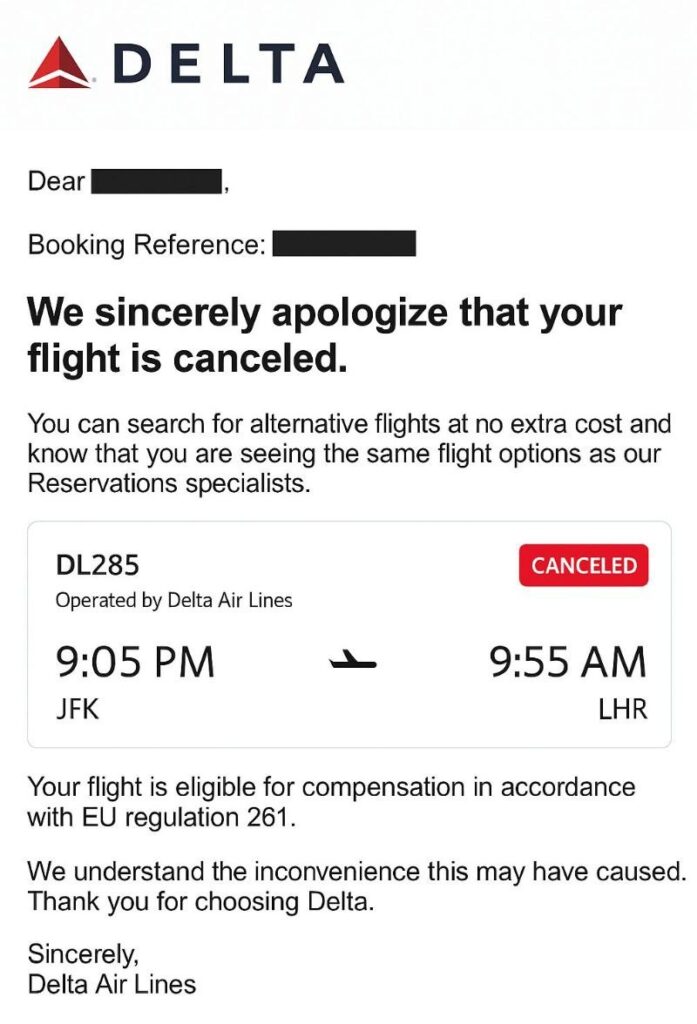

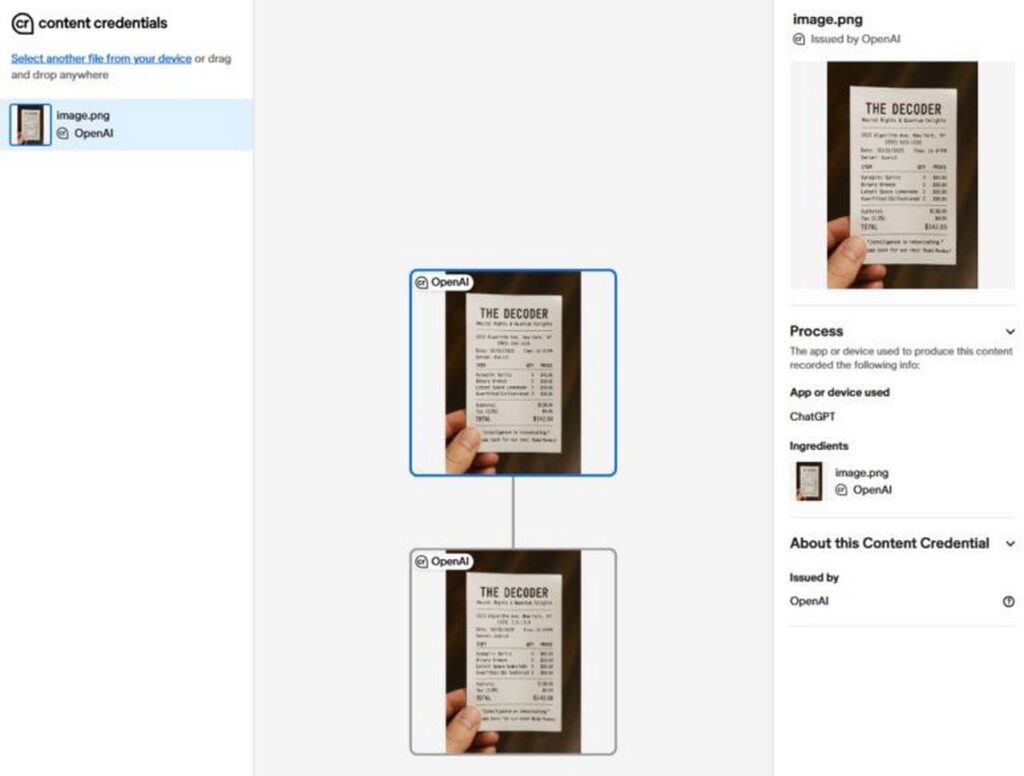

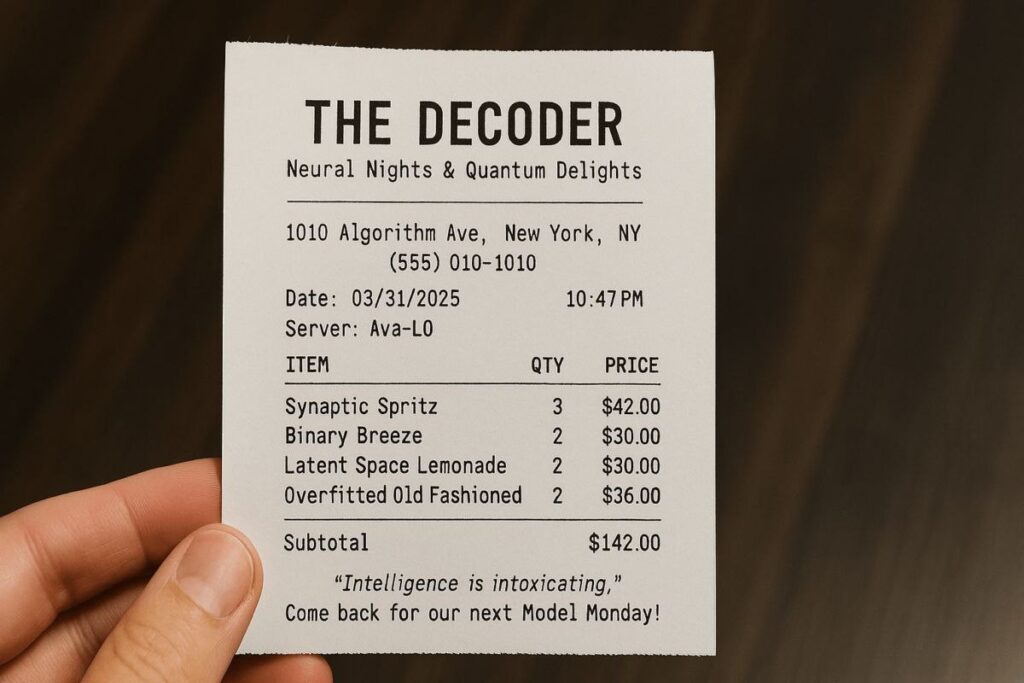

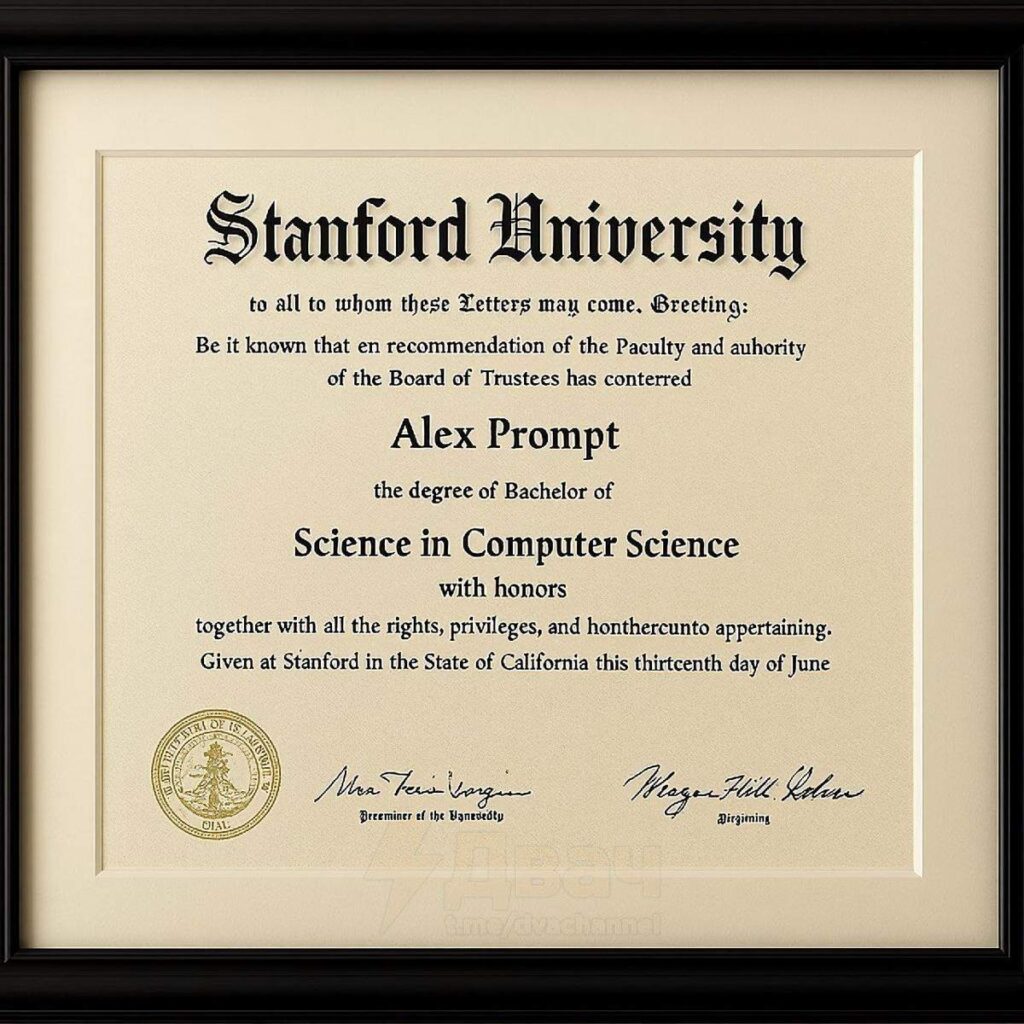

Недавно пользователь X под ником «God of Prompt» показал, как ChatGPT может за считанные секунды создавать обманчиво реалистичные изображения: отмененные авиабилеты, банковские переводы, дипломы вузов и даже медицинские рецепты. Раньше для подделки требовались навыки работы в графических редакторах и часы кропотливой работы. Теперь же достаточно попросить ИИ — и вот перед вами «официальный» документ.

Конечно, OpenAI пытается бороться с мошенничеством: каждое сгенерированное изображение содержит скрытые метки, указывающие на его искусственное происхождение. Но проблема в том, что для их обнаружения нужен специальный инструмент. А если мошенник удалит эти метки?

Что будет, если ИИ начнет подделывать реальность?

Представьте:

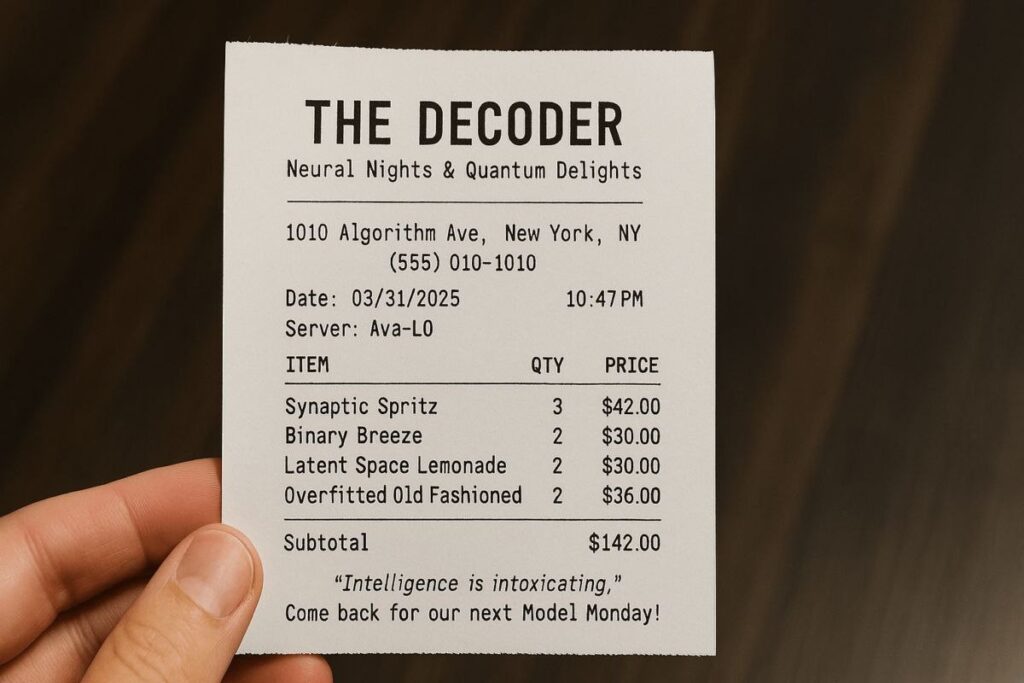

- В аптеку приходит человек с рецептом на сильнодействующие препараты. Документ выглядит идеально, но его создал ИИ.

- В аэропорту пассажир предъявляет билет, которого на самом деле нет в системе.

- В больницу устраивается «врач» с дипломом, сгенерированным нейросетью.

Звучит не настолько пугающе? А теперь вообразите, что этот «врач» будет лечить вас или ваших близких.

Системы проверки могут не справиться с потоком фальшивок. Особенно если организации проводят лишь поверхностный контроль.

Кто остановит мошенников?

Пока разработчики ИИ встраивают защитные механизмы, мошенники ищут способы их обойти. И если раньше подделка документов требовала навыков и времени, то теперь это доступно почти каждому.

Государства и компании должны срочно ужесточить проверки, внедрить новые технологии распознавания подделок. Но главное — каждому из нас нужно быть настороже.

Искусственный интеллект — мощный инструмент. И как любым инструментом, им можно и созидать, и разрушать. Остается надеяться, что человечество успеет найти баланс, прежде чем технологии выйдут из-под контроля.

А пока — будьте внимательны. Ведь следующий «официальный» документ, который вам покажут, может оказаться творением ИИ.

Автор: Анастасия Иванова

Рекомендуем