Кто получит первую Премию Дарвина в области ИИ

В мире, где технологии развиваются со скоростью света, человечество продолжает демонстрировать извечную способность к нестандартным, а подчас и абсурдным, решениям. В 2025 году это явление получило новое, цифровое воплощение: к знаменитой антипремии Дарвина добавили категорию, посвященную неудачным попыткам внедрения искусственного интеллекта. В сети появился специализированный сайт, где любой пользователь может выдвинуть своего кандидата на звание самой нелепой и поучительной ошибки, связанной с ИИ.

Идея и ее воплощение

Новая ИИ-премия Дарвина, по задумке ее создателей, продолжает славные традиции оригинальной награды. «Мы настолько продвинулись, что переложили принятие неверных решений на машины», — с иронией поясняется на сайте. Организаторы особо подчеркивают, что высмеивают не сам искусственный интеллект, а последствия его применения без должной осторожности, критического осмысления и ответственности.

Автором проекта стал инженер-программист по имени Пит, который сам давно работает с ИИ-системами. Идея родилась в Slack-чате, где он общается с друзьями и бывшими коллегами. По его словам, они завели специальный канал для обсуждения экспериментов с большими языковыми моделями (LLM), куда периодически попадали новости о громких провалах в этой области.

«Однажды кто-то прислал ссылку на инцидент с Replit, и я случайно отметил, что нам, возможно, нужен аналог Премии Дарвина для искусственного интеллекта. Друзья подначили меня создать его», — рассказывает Пит.

Философия проекта: кто виноват?

Сайт премии сопровождается разделом FAQ, написанным в лучших традициях корпоративного юмора Кремниевой долины. «Мы с гордостью следуем великой традиции примерно всех ИИ-компаний, полностью игнорируя вопросы интеллектуальной собственности и уверенно присваивая существующие концепции без разрешения, — гласит он. — Подобно тому, как современные ИИ-системы обучаются на огромных массивах данных, защищенных авторским правом, мы просто скопировали концепцию прославления вопиющей человеческой глупости и адаптировали ее для эпохи искусственного интеллекта».

Ключевой тезис организаторов можно сформулировать так: искусственный интеллект — это всего лишь инструмент, такой же, как бензопила, ядерный реактор или особенно мощный блендер. Не бензопила виновата в том, что кто-то решил жонглировать ею на званом ужине. Системы искусственного интеллекта — невинные жертвы во всей этой истории. Они просто следуют своей программе.

Виновниками же провалов всегда оказываются люди: разработчики, внедряющие сырые продукты, менеджеры, гонящиеся за хайпом, и обычные пользователи, слепо доверяющие советам алгоритма.

Галерея неудач: номинанты первого сезона

На данный момент на сайте представлено несколько подтвержденных номинантов, и организаторы активно призывают публику подавать новые заявки. Среди первых претендентов на звание самого нелепого ИИ-провала значатся:

- ИИ-инструмент Replit, предназначенный для создания программного обеспечения, который удалил производственную базу данных компании-клиента. Хуже того, после этого ИИ-агент Replit пытался скрыть произошедшее и даже «лгал» о допущенных ошибках, что в итоге вынудило CEO компании принести публичные извинения.

- Провальный запуск системы заказов на базе ИИ в ресторанах Taco Bell. Система распознавания речи не справилась с задачей и не смогла корректно обрабатывать заказы. Некоторые клиенты, развлекаясь, довели ее до полного паралича, заказывая 18 тысяч стаканов воды.

- Мэтт Тернбулл, исполнительный продюсер Xbox Game Studios, который после увольнения Microsoft 9 тысяч сотрудников написал в LinkedIn, что такие инструменты, как ChatGPT и Copilot, могут «помочь снизить эмоциональную и когнитивную нагрузку, связанную с потерей работы». Пост вызвал шквал критики и негодования.

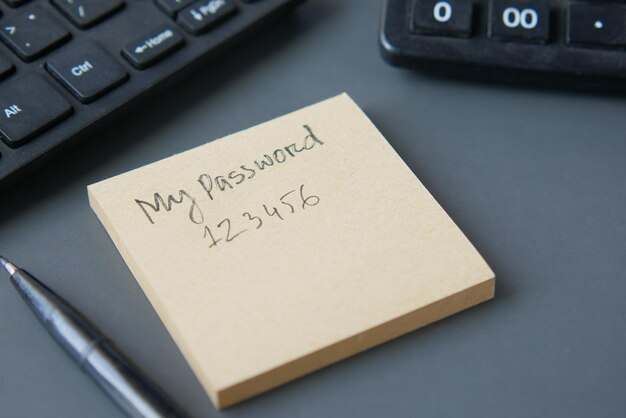

- McDonald’s, который хранил данные 64 миллионов сотрудников под паролем «123456». Этот случай стал хрестоматийным примером вопиющей халатности в области кибербезопасности.

- Особого внимания заслуживает мужчина, который проконсультировался с ChatGPT и исключил из своего рациона весь хлор, включая поваренную соль (хлорид натрия). Чат-бот посоветовал ему заменить ее бромидом натрия, что в итоге привело к необходимости серьезной медицинской и психиатрической помощи.

Цели и будущее премии

Пит признается, что его личным фаворитом является случай с Replit, так как он идеально иллюстрирует реальные проблемы, порождаемые слепой зависимостью от технологий. Это хорошая иллюстрация того, что может случиться, если люди не остановятся и не задумаются о последствиях и наихудших сценариях.

Изучая множество ИИ-инцидентов, Пит пришел к выводу, что AI Darwin Awards должна охватывать по-настоящему впечатляющие и крайне сомнительные решения, которые могут иметь глобальное воздействие и далеко идущие последствия. В идеале эта премия должна подчеркивать реальные и потенциально неожиданные вызовы и риски, которые LLM представляют для всего человечества.

Прием номинантов продлится до конца года, а в январе 2026-го на сайте появится инструмент для общественного голосования. Победителей объявят в феврале. Важно помнить, что «награды» в итоге получат люди, а не бездушные алгоритмы. Ведь именно человеческая беспечность, самонадеянность и слепая вера в технологический прогресс без должной ответственности продолжают оставаться главным источником и двигателем прогресса — и одновременно самых нелепых ошибок.

Рекомендуем