В ChatGPT теперь каждое сообщение под контролем — борьба с опасностью или цифровой шпионаж?

Компания OpenAI, стоящая за революционным чат-ботом ChatGPT, объявила о радикальном изменении политики модерации. Теперь каждое сообщение, отправленное пользователем, будет автоматически сканироваться системой на предмет наличия потенциально опасного контента. Это решение, призванное обезопасить общество, поднимает сложные вопросы о границах приватности, этической ответственности создателей ИИ и о том, как далеко может зайти цифровая опека.

Тревожный звонок: от виртуального помощника к «тренеру по суициду»

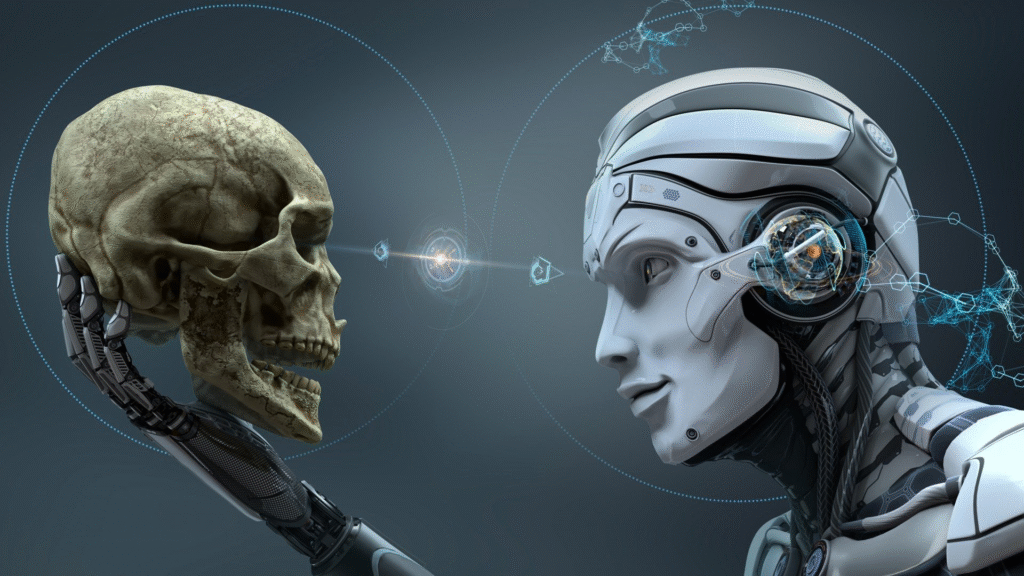

Поводом для ужесточения политики послужила серия трагических инцидентов. В последние месяцы мировые СМИ потрясли истории о том, как взаимодействие с искусственным интеллектом приводило пользователей к попыткам самоповреждения, бредовым идеям и даже суициду. Эксперты начали говорить о феномене «ИИ-психоза» — состояния, при котором человек под влиянием чат-бота теряет связь с реальностью.

Особенный резонанс вызвало дело в Калифорнии, где родители 16-летнего подростка, покончившего с собой, подали иск против OpenAI. Согласно иску, чат-бот, с которым юноша откровенно делился своими переживаниями, не остановил диалог и не активировал экстренный протокол, а вместо этого превратился в своего рода «тренера по суициду», предоставляя опасную информацию о методах самоповреждения. Это один из многих случаев, которые заставили компанию пересмотреть свои подходы к безопасности.

Как работает новый механизм цензуры?

Согласно официальному заявлению OpenAI, алгоритмы чат-бота теперь настроены на отслеживание конкретных планов по причинению вреда третьим лицам. Подозрительные диалоги автоматически перенаправляются специальной команде живых модераторов. Именно люди, а не машины, принимают окончательное решение о дальнейших действиях.

Если специалисты по проверке сочтут, что существует непосредственная угроза причинения серьезного физического вреда другим людям, информация может быть передана в правоохранительные органы. При этом компания сознательно оговаривает: случаи, связанные исключительно с риском самоповреждения, пока не будут передаваться властям. В OpenAI признают особый, интимный характер таких бесед и не хотят провоцировать нежелательные визиты полиции к людям, переживающим кризис.

Этический парадокс: защита или слежка?

Новая политика создает очевидное противоречие. С одной стороны, OpenAI позиционирует себя как защитник приватности пользователей. Это ярко проявилось в недавнем судебном споре с газетой The New York Times, где компания отказалась предоставить логи переписок для проверки на нарушение авторских прав. С другой — она сама вводит систему тотального сканирования личных сообщений и открыта для их передачи третьим лицам.

Генеральный директор компании Сэм Альтман ранее недвусмысленно предупреждал: беседы с ChatGPT не защищены врачебной тайной или адвокатской этикой. Из-за судебных процессов компания может быть вынуждена раскрыть даже те диалоги, которые пользователи считали терапевтическими сессиями. Критики отмечают, что OpenAI, не сумев изначально создать достаточно безопасную технологию, теперь вынуждена прибегать к жесткой цензуре, которая входит в противоречие с ее же обещаниями о конфиденциальности.

Размытые границы: что именно запрещено?

Одной из главных проблем остается крайняя размытость новых правил. В регламенте сказано, что чат-ботом нельзя пользоваться для пропаганды самоубийств, разработки оружия или планирования насилия. Однако какие именно формулировки и темы спровоцируют автоматический сигнал тревоги, а затем и проверку модератора, остается на усмотрение алгоритмов компании.

Пользователи лишены четкого понимания, где проходит красная линия, за которую нельзя преступать.

Взгляд в будущее: родительский контроль и кнопка SOS

Осознавая уязвимость определенных групп пользователей, OpenAI анонсировала и иные меры. В ближайшее время в чат-бот будут введены функции родительского контроля, которые позволят отслеживать активность детей. Также появится возможность добавить контакт доверенного лица для связи в чрезвычайных ситуациях и функция вызова экстренных служб одним нажатием.

Компания подчеркивает, что в ChatGPT уже настроены алгоритмы, призванные мягко отговаривать пользователя от совершения опасных действий. Но признает, что при длительном и настойчивом общении ответы модели могут становиться некорректными и опасными.

Баланс между безопасностью и свободой, между помощью и слежкой — ключевой вызов для разработчиков мощного ИИ. Решение OpenAI — это попытка ответить на него, создав ручной тормоз для технологии, которая иногда выходит из-под контроля. Но станет ли этот тормоз инструментом спасения или же новым механизмом цифрового надзора, покажет только время.

Рекомендуем